O fim da farra dos deepfakes no seu feed?

Se você já teve aquele pesadelo de ver seu rosto sendo usado em algum vídeo bizarro por aí, o YouTube finalmente deu um passo para tentar resolver esse caos. A plataforma do Google liberou oficialmente a sua ferramenta de detecção de deepfakes para todos os usuários maiores de 18 anos. Basicamente, agora você pode colocar a IA da gigante das buscas para caçar quem está tentando se passar por você na rede.

Essa funcionalidade não é exatamente nova — ela começou sendo testada com criadores de conteúdo selecionados e depois passou por figuras públicas, políticos e jornalistas. Agora, a porteira foi aberta para o cidadão comum. Se você tem medo de ter sua imagem replicada por uma IA mal-intencionada, essa é a ferramenta que você vai querer configurar assim que disponível na sua conta.

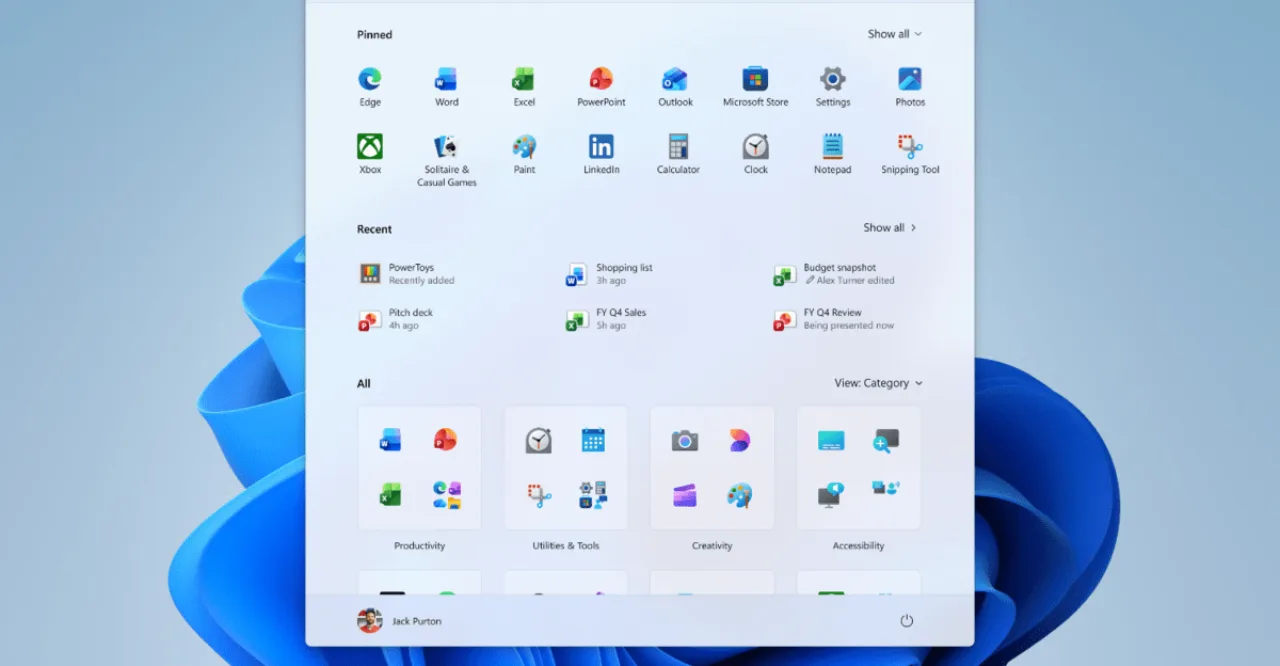

Como funciona a detecção de rostos do YouTube

A mecânica por trás disso é o que a gente chama de "escaneamento estilo selfie". Você fornece uma amostra do seu rosto para o sistema, e a inteligência artificial do YouTube começa a monitorar a plataforma em busca de correspondências. Se o algoritmo detectar um vídeo que parece ser uma versão gerada por IA da sua face, ele te manda um alerta.

A partir daí, a bola está com você. O sistema não deleta nada automaticamente (o que seria um pesadelo de moderação, convenhamos), mas ele te dá a opção de solicitar a remoção. É o famoso "denunciar por uso indevido de imagem", mas com o suporte de uma IA que já fez o trabalho sujo de encontrar o vídeo para você.

| Perfil | Nível de Proteção | Ação Recomendada |

|---|---|---|

| Usuário Comum | Monitoramento passivo | Ativar a verificação de rosto |

| Criador de Conteúdo | Monitoramento ativo | Revisar alertas semanalmente |

| Figura Pública | Prioridade máxima | Manter escaneamento atualizado |

Por que isso é uma faca de dois gumes?

Olha, é inegável que a tecnologia de deepfake evoluiu num ritmo assustador. Hoje em dia, qualquer pessoa com um PC razoável e acesso a ferramentas open-source consegue criar um conteúdo que engana muita gente. A iniciativa do YouTube é um movimento defensivo necessário, mas tem seus limites.

- Privacidade: Você está dando uma amostra do seu rosto para o Google. Se você é do tipo que não gosta de deixar biometria em nuvem, isso pode ser um ponto de atenção.

- Eficácia: O próprio YouTube admitiu que o número de remoções solicitadas até agora é "muito pequeno". Isso pode significar que os deepfakes ainda não são tão comuns quanto o pânico sugere, ou que a ferramenta ainda está aprendendo a filtrar tudo.

- Falsos Positivos: Existe sempre o risco de a IA confundir alguém parecido com você. Ninguém quer ter um vídeo legítimo removido por erro de algoritmo, né?

Apesar desses pontos, é melhor ter uma ferramenta de proteção do que ficar à mercê de bots criando vídeos seus vendendo golpe de criptomoeda ou coisa pior. A internet é um lugar selvagem, e ter o Google do seu lado nessa briga contra a IA generativa descontrolada é um alívio, mesmo que parcial.

Pra cada perfil, um vencedor

A pergunta que não quer calar é: essa ferramenta é pra todo mundo? Se você é uma pessoa que mantém um perfil baixo na internet, talvez não precise correr para configurar isso agora. Mas, se você é um criador de conteúdo, streamer ou alguém que tem uma presença digital minimamente relevante, é uma camada extra de segurança que você não deveria ignorar.

A grande questão aqui é a escala. O YouTube tem bilhões de vídeos subidos todos os dias. Monitorar tudo isso em tempo real é uma tarefa hercúlea, mesmo para uma empresa com os recursos do Google. Por enquanto, a ferramenta parece ser um filtro preventivo muito bem-vindo, mas não espere que ela resolva 100% dos problemas de roubo de identidade digital.

No fim das contas, a melhor defesa ainda é o bom senso e a verificação em duas etapas. Se você vir um vídeo seu que não se lembra de ter gravado, não entre em pânico: use a ferramenta, denuncie e siga o jogo. O futuro da internet vai ser cada vez mais sobre quem é real e quem é pixel, e pelo menos agora temos uma arma nessa guerra.